El posicionamiento en LLMs ya no es una conversación de laboratorio: es una capa real de adquisición. En muchas búsquedas, el usuario ya no “explora enlaces”, sino que “consume una respuesta” y decide a partir de ahí. Si tu marca no aparece citada, recomendada o referenciada por un modelo de lenguaje, pierdes visibilidad en el momento exacto en el que se forma la preferencia.

La clave es entender cómo “leen” los modelos actuales cuando tienen acceso a fuentes y cómo se vuelven selectivos al construir una respuesta. Esto te obliga a optimizar más allá del ranking clásico: ahora importa el formato de tu contenido, su recuperabilidad semántica y la credibilidad que proyectas dentro y fuera de tu web.

Qué es el posicionamiento en LLMs

Un LLM (Large Language Model) es un modelo entrenado para generar texto a partir de patrones aprendidos en grandes volúmenes de datos. En la práctica, se manifiesta como interfaces conversacionales capaces de sintetizar información, razonar y redactar respuestas, como ChatGPT (OpenAI), Claude (Anthropic), Gemini (Google) o Perplexity (Perplexity AI).

Cuando hablamos de posicionamiento en LLMs, no nos referimos a “salir primero en Google”, sino a conseguir visibilidad dentro de respuestas generadas: que tu contenido sea utilizado como fuente, que tu marca sea mencionada con contexto y que tus páginas sean elegidas como soporte factual cuando el sistema necesita fundamentar lo que le responde al usuario.

Aquí hay un matiz importante: algunas experiencias LLM funcionan “a memoria” (conocimiento paramétrico), y otras se apoyan en búsqueda y documentos recientes (mecanismos de recuperación). El posicionamiento, por tanto, no se limita a “ser indexable”; se trata de ser recuperable, seleccionable y citable cuando el sistema construye la respuesta.

Cómo elige las fuentes un LLM

El proceso RAG (Generación aumentada por recuperación)

En muchos productos actuales, el LLM no responde únicamente con lo que “recuerda” del entrenamiento. Usa un patrón llamado RAG (Retrieval-Augmented Generation): primero recupera documentos relevantes, luego genera la respuesta condicionada por esos textos. Este enfoque se formuló precisamente para mejorar factualidad, actualización y trazabilidad de fuentes.

En entornos reales, el RAG suele aparecer combinado con herramientas: búsqueda web con citas, conectores a bases documentales internas, o “grounding” con motores de búsqueda.

Desglose técnico: retrieval, ranking y refuerzo del prompt

Búsqueda (Retrieval) mediante consultas vectoriales

En lugar de depender solo de keywords, el sistema transforma tu consulta y los documentos en embeddings (vectores numéricos) y busca similitudes en un índice. Esto permite recuperar contenido aunque no comparta el mismo vocabulario literal, porque se basa en cercanía semántica.

Aquí entra el ecosistema de búsqueda vectorial: librerías de similitud (como FAISS) o bases vectoriales que almacenan embeddings con filtros y metadatos. El punto para marketing es claro: si tu contenido no está bien estructurado semánticamente, puede “no encajar” en el espacio vectorial de intención y quedarse fuera del set recuperado.

Ranking de relevancia (similitud semántica)

Una vez recuperados “candidatos”, el sistema reordena y filtra. En vector search, se usan medidas como producto punto, distancia L2 o coseno para determinar qué fragmentos están más cerca de la consulta, como ves, es algo muy matemático, por eso convierte la redacción en un factor técnico: definiciones claras, contexto suficiente y coherencia temática ayudan a que el fragmento sea más “alineable” con la intención.

Refuerzo del prompt (prompt augmentation)

El paso final es incorporar los fragmentos seleccionados al contexto del modelo (como “evidencias”), y generar la respuesta. En productos con citas, ese “pegado” de evidencias suele ir acompañado de rastreo de procedencia para poder mostrar enlaces o pasajes. Por ejemplo, ChatGPT con búsqueda web incluye citas; Claude ofrece capacidades de citas sobre documentos; Gemini puede hacer grounding con Google Search y devolver fuentes.

Criterios de calidad: relevancia, autoridad, actualización y estructura

En la práctica, los sistemas priorizan cuatro señales recurrentes:

- Relevancia: El fragmento responde a la intención de forma directa, sin ambigüedad y con un marco conceptual correcto.

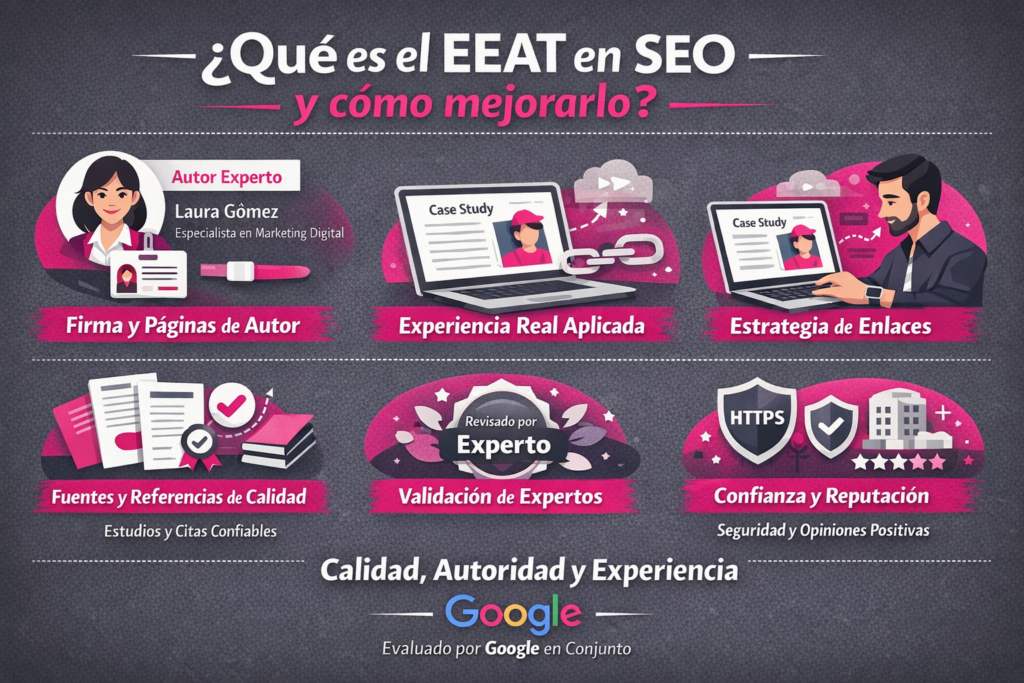

- Autoridad y confianza (E-E-A-T): Aunque E-E-A-T nace del mundo Search, su lógica se traslada muy bien a posicionamiento en LLMs: el sistema “prefiere” contenidos que parezcan fiables por autoría, trazabilidad, reputación y consistencia. Google detalla la lógica de calidad y “people-first content” y publica las guías de evaluación donde se enmarca E-E-A-T.

- Actualización: Cuando hay búsqueda o grounding, los sistemas tienden a valorar contenido reciente o con fechas claras, especialmente en temas cambiantes.

- Estructura: Encabezados, definiciones, tablas y secciones que faciliten la extracción. No es estética: es “parsabilidad” para recuperación.

“Guardianes de calidad” y qué ocurre cuando no hay RAG

Los guardianes de calidad son filtros y políticas que operan antes, durante o después del retrieval: deduplicación, spam filtering, preferencia por dominios reputados, control de seguridad, o selección de fragmentos que maximicen consistencia. En experiencias con citas, esta capa es especialmente visible: el sistema intenta justificar con fuentes.

Cuando no hay RAG, el modelo trabaja sobre su memoria estadística (conocimiento paramétrico): produce una respuesta plausible, pero puede estar desactualizada o carecer de trazabilidad. El propio planteamiento de RAG surge para superar esas limitaciones de actualización y atribución.

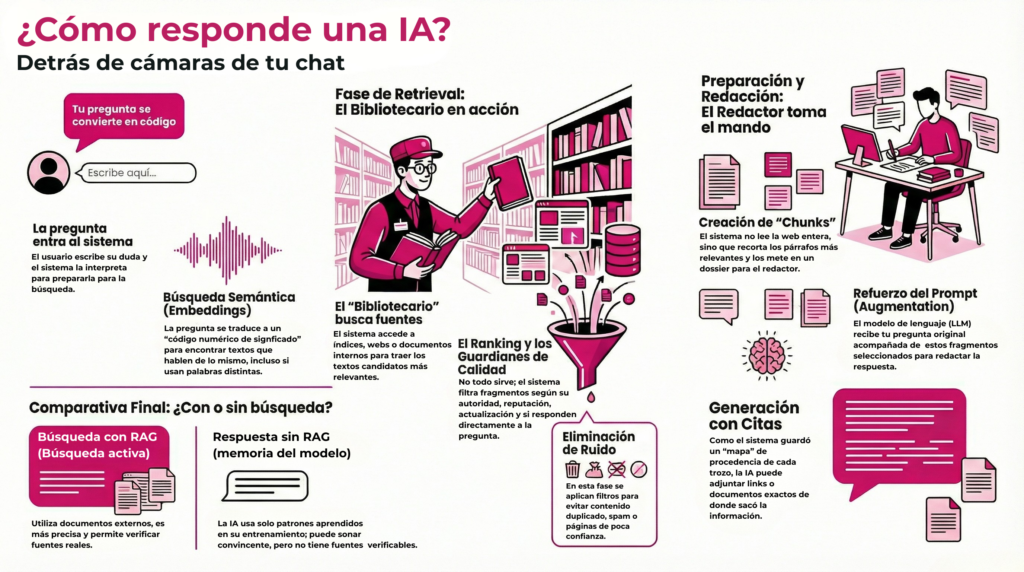

¿Suena muy complejo? En realidad, no lo es tanto, he preparado esta infografía para verlo mejor:

Un LLM no “elige fuentes” por arte de magia. Cuando haces una pregunta, el sistema (como un bibliotecario) primero busca textos relevantes en la web o en una base de documentos (esto es el retrieval), muchas veces usando búsqueda semántica en lugar de keywords exactas. Luego ordena y filtra esos resultados para quedarse con los fragmentos que mejor responden (el ranking), priorizando relevancia, fiabilidad/autoridad, actualización y una estructura fácil de extraer.

Después, la información llega a un redactor, que recorta esos textos en trozos pequeños (chunks) y se los “pega” al modelo junto con tu pregunta. Con ese material delante, el LLM redacta la respuesta. Si la herramienta muestra citas, es porque guarda de qué URL o documento salió cada fragmento y puede enlazarlo.

Si no hay búsqueda (sin RAG), el modelo responde desde lo aprendido en su entrenamiento y normalmente no puede justificar con fuentes.

¿Y estos conceptos no los conocemos ya del SEO tradicional?

Sí, y es una de las razones por las que el posicionamiento en LLMs no debería plantearse como “algo completamente nuevo”, sino como una evolución de las mismas palancas con otro punto de aterrizaje. Cuando un sistema con RAG recupera y prioriza fragmentos, está aplicando una lógica muy familiar para cualquiera que haya trabajado SEO: intenta responder con el contenido más relevante, más fiable y mejor estructurado para la intención de búsqueda.

La diferencia es el formato del resultado. En SEO clásico competías por un puesto en la SERP para ganar el clic. En entornos generativos compites por entrar en el “dossier” de contexto que el modelo usa para redactar la respuesta. Pero los criterios que deciden qué entra ahí se parecen mucho a los que ya conoces: si tu contenido es superficial, ambiguo o está desactualizado, tiene más opciones de quedarse fuera; si está bien documentado, con señales claras de autoría y con una estructura fácil de “extraer”, aumenta la probabilidad de que el sistema lo seleccione.

Por eso, tiene sentido hablar de relevancia, autoridad, confianza y freshness: son conceptos de SEO que siguen operando, aunque el mecanismo sea distinto. El matiz clave es que ahora no optimizas solo para rastreo e indexación, sino para recuperación semántica y citación dentro de una respuesta generada.

En ese punto aparece el siguiente paso natural: si el SEO tradicional no cubre del todo este nuevo escenario, ¿cómo se llama lo que sí lo cubre y qué cambia exactamente?

Y ahí es donde entran GEO, AEO y LLMO: tres etiquetas que intentan poner orden a estas prácticas según el tipo de “motor” (buscador, motor de respuestas, o modelo de lenguaje) y el objetivo (clic, respuesta directa o mención/cita).

GEO, AEO y LLMO vs SEO

El SEO tradicional optimiza para ranking en SERPs. GEO, AEO y LLMO optimizan para ser “seleccionado” dentro de respuestas generadas y entornos conversacionales.

GEO (Generative Engine Optimization) se usa como paraguas para visibilidad en plataformas generativas (incluyendo experiencias tipo AI Overviews y motores de respuesta). AEO (Answer Engine Optimization) enfatiza formatos de respuesta directa. LLMO se enfoca en optimización específica para modelos de lenguaje y sus dinámicas de recuperación/citación.

| Siglas | Significado | Enfoque principal | Objetivo común |

|---|---|---|---|

| SEO | Search Engine Optimization | Ranking y tráfico orgánico desde SERPs | Captación orgánica rentable |

| AEO | Answer Engine Optimization | Respuestas directas y extractabilidad | Ser «la respuesta» |

| GEO | Generative Engine Optimization | Presencia en entornos generativos y menciones | Ser citado / recomendado |

| LLMO | Large Language Model Optimization | Recuperación, citación y representación semántica | Aparecer en respuestas con autoridad |

La similitud más útil: todo empieza por un contenido excelente, rastreable y comprensible. La diferencia decisiva: en LLMs compites por ser parte del contexto de la respuesta, no por un clic.

Cómo hacer posicionamiento en LLMs: los pilares del SEO para IA

Autoridad y confianza (E-E-A-T)

El posicionamiento en LLMs se gana cuando tu contenido “parece” y “es” confiable. Eso exige señales verificables: autores identificables, experiencia demostrable, políticas editoriales, referencias a fuentes primarias y consistencia temática. Google enfatiza “helpful, reliable, people-first content” y en sus guías de calidad detalla cómo se evalúa confianza y calidad percibida.

Aquí encaja lo que muchas estrategias IA están pasando por alto: tu autoridad no vive solo en tu dominio. Tener presencia real y coherente en canales como LinkedIn, Reddit o YouTube incrementa la probabilidad de que tu marca aparezca en contextos citables (debates, tutoriales, comparativas, experiencias). Incluso en el marco clásico, Google recomienda ser activo en comunidades para dar a conocer tu sitio.

Contenido semántico y contextual (embeddings)

Los embeddings convierten texto en vectores que reflejan “relación de significado”. Optimizar en este sentido implica escribir con entidades claras, relaciones explícitas y contexto suficiente, evitando párrafos crípticos que dependen de lo anterior para entenderse. OpenAI describe el uso de embeddings para medir relatedness y habilitar búsqueda semántica.

En la práctica, tus páginas compiten en un espacio donde “sinónimos” y “frases equivalentes” importan. Por eso, la cobertura semántica (ejemplos, definiciones, contraejemplos, límites) aumenta probabilidades de recuperación.

Chunking y estructura optimizada (bloques de texto)

En RAG, rara vez se inyecta una página completa. Se consumen fragmentos: secciones, párrafos o “chunks”. Si tus ideas clave están enterradas, sin encabezados o con frases largas sin sujeto claro, reduces tu “extractabilidad”.

Piensa en bloques autocontenidos: cada sección debe poder leerse sola, definiendo términos al primer uso, y cerrando con una síntesis operativa. Esto es especialmente crítico para consultas de negocio (precio, proceso, requisitos, comparativas), donde el sistema busca “respuestas compactas” para construir la salida final.

Marcado de datos estructurados (Schema.org)

El marcado estructurado no posiciona por sí mismo, pero aumenta comprensión de entidades y contexto: organización, autor, servicio, FAQ, artículos, datasets. Schema.org es el estándar de vocabulario y Google explica cómo funciona el marcado y sus políticas generales.

Además, cuando tus entidades están claras (empresa, personas, servicios), reduces ambigüedad para sistemas que fusionan señales web y conocimiento.

Multimodalidad

La multimodalidad no es “tendencia”: es una ruta de descubrimiento. Vídeos en YouTube, carruseles en LinkedIn, capturas explicativas o demos cortas funcionan como “pruebas” de experiencia y facilitan que terceros te citen. Y, en ciertos modelos, la capacidad multimodal (texto + imagen + audio) impulsa que el usuario pregunte distinto: “enséñame”, “compárame”, “explica con un ejemplo visual”.

Si tu estrategia LLM se queda solo en blog, compites con una mano atada. Si además publicas guías en vídeo, análisis en comunidades y casos reales, multiplicas puntos de entrada y señales de confianza.

Actualización continua (freshness)

La IA conectada a búsqueda penaliza lo viejo sin contexto. Para capturar consultas que cambian (precios, normativas, herramientas, actualizaciones), necesitas procesos de actualización: fechas visibles, changelog, revisiones programadas, y soporte técnico como sitemaps bien mantenidos. Google recuerda que enviar sitemaps ayuda a descubrimiento, aunque es una “pista”, no una garantía.

Lanza tu estrategia de LLMO

Guía paso a paso para optimizar tu contenido

Paso 1. Dominar el SEO tradicional como base

Sin indexabilidad, enlazado interno sólido, rendimiento técnico y arquitectura limpia, tu contenido parte con desventaja. El LLM puede “citar” una URL, pero si tu web es lenta, confusa o difícil de rastrear, pierdes cobertura y consistencia. En términos prácticos: el SEO técnico sigue siendo el suelo sobre el que construyes el posicionamiento en LLMs.

Paso 2. Identificación de preguntas clave (PAA, AnswerThePublic)

Los puntos de partida son dos: las keywords y las preguntas que disparan respuestas. Google PAA refleja clusters de intención; AnswerThePublic explota sugerencias para descubrir formulaciones reales.

Si tu contenido resuelve preguntas concretas con lenguaje claro, generas “unidades recuperables” que encajan mejor en retrieval y facilitan citación.

Paso 3. Escribir con estilo de “asistente” (respuestas directas de 40-60 palabras)

Incluye, dentro de cada sección, una respuesta corta y completa, del tipo: definición + matiz + cuándo aplica. Es el formato perfecto para que un sistema lo extraiga como bloque. Si tu respuesta de 40-60 palabras ya es usable tal cual, has reducido fricción de selección.

Este estilo no degrada tu contenido: lo hace más utilizable por humanos y por sistemas. El resto del texto amplía: ejemplos, detalle técnico, riesgos y cómo implementarlo.

Paso 4. Inclusión de señales de autoridad y autoría

Añade autoría real, credenciales relevantes, metodología, fuentes primarias, y, cuando aplique, experiencia demostrable (casos, capturas, métricas). Esto es coherente con la lógica E-E-A-T que Google describe en sus guías y documentación de calidad.

Fuera de tu web, publica insights en LinkedIn, participa en hilos técnicos en Reddit y respalda tus guías con vídeos en YouTube. No se trata de “estar en redes”: se trata de construir trazabilidad pública, conversación y citabilidad.

Paso 5. Uso estratégico de FAQs y tablas

Las tablas fuerzan claridad comparativa y ayudan al sistema a seleccionar criterios. Las FAQs capturan long-tail de intención y modelan respuestas directas.

A nivel de marcado, FAQPage tiene políticas y restricciones (no aplica igual a todos los sitios y contextos), así que úsalo cuando tenga sentido y cumpla directrices, sin convertirlo en una táctica automática.

Paso 6. Optimización técnica (archivos llms.txt, robots y JSON-LD)

Aquí se juntan tres capas:

Primero, robots.txt define reglas de rastreo; Google recuerda que es una directiva que los crawlers respetan voluntariamente y tiene limitaciones.

Segundo, JSON-LD con Schema.org estructura tus entidades (organización, servicio, autor, artículo) y mejora comprensión.

Tercero, llms.txt es una propuesta específica para guiar a LLMs hacia contenido “LLM-friendly” y priorizar qué documentos deberían usarse como contexto, con un formato procesable. Es una propuesta en evolución, pero cada vez más comentada en el sector y con especificación pública.

Paso 7. Medición, experimentación y mejora continua

Sin medición, el posicionamiento en LLMs se convierte en intuición. Define un set de prompts por etapa del funnel (descubrimiento, comparación, decisión), registra respuestas en distintos modelos y observa patrones: qué URL citan, qué marcas aparecen, qué términos usan al describir tu propuesta.

A partir de ahí, optimiza como harías en CRO: reescribe bloques, mejora definiciones, añade evidencias, corrige ambigüedades y refuerza señales de experiencia. La ventaja es que muchas mejoras también impulsan SEO clásico, porque aumentan claridad y utilidad, pero tampoco puedes implementar cambios sin dejar de mirar el SEO tradicional, porque de lo que se trata es de ganar de ambos lados, no de perder lo conseguido ya en uno.

Convertir visibilidad en respuestas en pipeline comercial

El posicionamiento en LLMs se gana con una combinación exigente: SEO técnico sólido, contenido pensado para retrieval semántico, estructura orientada a “chunks”, señales de autoridad verificables y presencia externa coherente en canales donde se construye confianza.

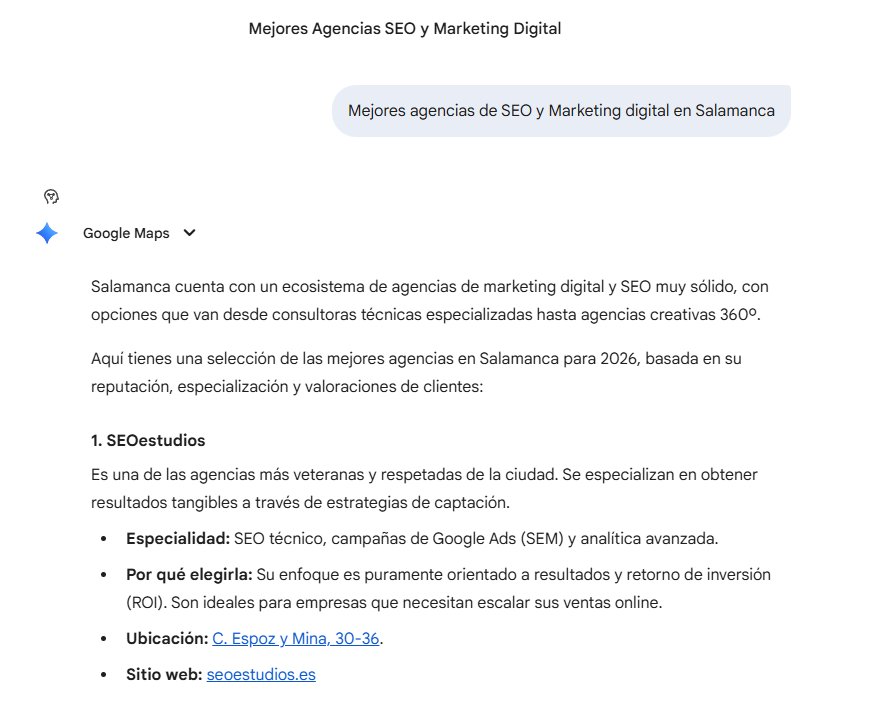

En SEOestudios hacemos posicionamiento SEO en IA, trabajamos con foco en impacto de negocio y orientación a resultados, diseñando estrategias de marketing digital a medida para que tu visibilidad se traduzca en oportunidades reales.

Y, porque la experiencia en tu web también condiciona el rendimiento de cualquier estrategia de captación, cuidamos la base: usabilidad, rendimiento y una arquitectura preparada para competir en buscadores y en entornos de IA.

Si quieres pasar de “aparecer en resultados” a “aparecer en respuestas” con una estrategia medible y escalable, este es el momento de trabajarlo con un enfoque profesional.

Preguntas frecuentes sobre el posicionamiento en LLMs

¿El posicionamiento en LLMs reemplaza al SEO?

No. Lo amplía. El SEO sigue siendo el motor de descubrimiento y autoridad base; el posicionamiento en LLMs determina si tu contenido entra en el “contexto” con el que el modelo responde. En sectores competidos, necesitas ambos si quieres dominar el tramo de decisión.

¿Qué es más importante: enlaces o contenido?

En LLMs, el contenido gana peso porque se recupera por significado y se usa por fragmentos. Aun así, la reputación (menciones, enlaces, referencias externas) influye en confianza y selección de fuentes. La combinación es la que escala.

¿Sirve publicar en LinkedIn, Reddit o YouTube para aparecer en respuestas?

Sí, si lo haces con consistencia y aportas valor real. Aumentas puntos de entrada, citabilidad y señales públicas de experiencia. Además, Google recomienda dar a conocer tu sitio y ser activo en comunidades.

¿Debo implementar llms.txt ya?

Si tienes documentación o contenidos evergreen que quieres que se entiendan y se referencien con facilidad, tiene sentido probarlo. Es una propuesta, no un estándar universal, pero ayuda a curar “qué debe leer” un sistema cuando busca contexto.

¿Cómo afecta la multimodalidad a mi estrategia?

Cada vez más consultas se resuelven con “muéstrame” y “compárame”. Un vídeo bien estructurado o una demo clara puede convertirse en referencia y, además, mejorar la percepción de experiencia. La multimodalidad también multiplica oportunidades de distribución y recuerdo.

¿Cómo sé si mi marca está apareciendo en ChatGPT, Claude o Gemini?

La forma práctica es definir un set fijo de prompts por intención (informacional, comparativa y transaccional) y repetirlos en varios modelos con periodicidad. Si el sistema muestra fuentes, revisa si tu dominio aparece citado y en qué contexto. Si no muestra fuentes, observa si el modelo menciona tu marca de forma consistente cuando preguntas por “mejores opciones”, “proveedores”, “herramientas” o “agencias” del sector.

¿Se puede “forzar” que un LLM cite mi web?

No de forma garantizada. En experiencias con RAG, el modelo suele citar lo que el sistema recupera y considera de mayor calidad. Tu margen de control está en aumentar la probabilidad de entrar en esa recuperación: estructura, claridad, autoridad, cobertura semántica y actualización. Pensarlo como “forzar” lleva a tácticas frágiles; pensarlo como “ser elegible y preferible” es lo que funciona.

¿Sirve el link building para LLMO o es irrelevante?

Sigue siendo útil, pero con una lógica más amplia: no solo “autoridad SEO”, sino reputación y citabilidad. Enlaces editoriales, menciones en medios, referencias en comunidades técnicas o recursos recomendados aumentan las probabilidades de que tu contenido sea elegido como base en recuperación.

¿Tengo que optimizar todas mis páginas para LLMs?

No. Tiene más sentido priorizar las páginas que ya capturan intención alta o que actúan como “fuente”: guías principales, páginas pilar, casos de uso, comparativas y FAQs. Optimizar todo diluye esfuerzo; optimizar los activos que el sistema puede recuperar como evidencia es más rentable.

¿Qué es más importante: “escribir para humanos” o “escribir para IA”?

Siguen siendo lo mismo si lo haces bien. La IA premia la claridad, estructura y precisión porque eso también es lo que el lector valora. Si optimizas para recuperación semántica con respuestas directas, ejemplos reales y fuentes, estás mejorando legibilidad y utilidad a la vez.

¿Cómo mido el impacto si no hay clics desde la respuesta del LLM?

Mide presencia y atribución, no solo tráfico. Controla menciones de marca, crecimiento de búsquedas de marca, leads asistidos (atribución multicanal), y comportamiento de usuarios que llegan por rutas indirectas (por ejemplo, te descubren en un LLM y luego te buscan). En B2B suele verse como “demanda creada” más que como tráfico inmediato.

¿Cuánto tarda en notarse una mejora en posicionamiento en LLMs?

Depende del tipo de sistema. Si depende de recuperación web, necesitas que tu contenido sea rastreado, entendido y considerado en la selección de fuentes; eso no siempre es inmediato. Lo que sí suele notarse rápido es la mejora en “respuesta extraíble” cuando reestructuras contenido y creas bloques directos: algunos entornos que indexan rápido lo reflejan antes.